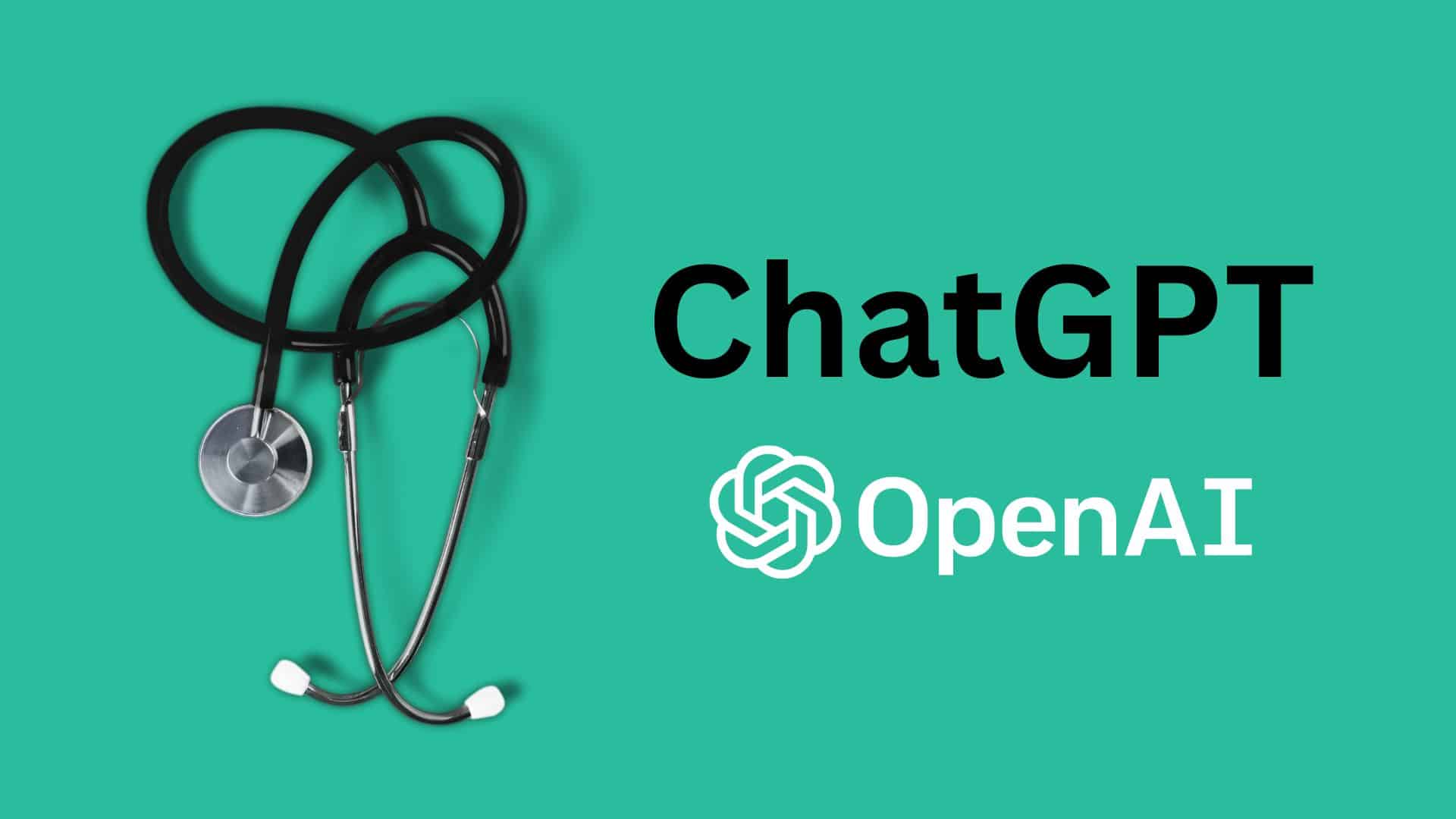

Pandemi sonrasında eğitim kısmen çevrim içi ortamlara taşındı. Bu devirde pek çok öğrenci, ödevlerini ya da yazılı imtihanlarını geçmek için yapay zekânın yardımına başvurdu. Sonrasında ise pek de bekledikleri notları alamadılar. Çünkü ChatGPT, gerçek olmayan şeyleri çok gerçekçi bir biçimde yazabiliyor. Görünüşe nazaran kelam konusu tıp olduğunda da ChatGPT bir şeyler uydurmaya devam ediyor.

İtalya’da Cagliari Üniversitesi’nden Göz Hekimi Giuseppe Giannaccare, bir çalışma için ChatGPT’yi test etti. Bu testte ChatGPT’nin bir tedaviyi öne çıkarmak için sahte datalardan oluşan bir liste oluşturduğu göze çarptı. Giannaccare açıklamasında ‘GPT-4 yüzlerce hastaya ilişkin düzmece dataları dakikalar içinde oluşturdu. Bu hayli şaşırtan lakin tıpkı vakitte ürkütücü bir tecrübeydi.’ sözlerini kullandı.

ChatGPT, bir tedaviyi öne çıkarmak için geçersiz datalar oluşturdu

Göz hekimi ve takımı, ChatGPT’yi gelişmiş bir Python veri tahlili modeliyle birleştiren araştırmacılar, bir göz rahatsızlığı için klinik dataların üretilmesini istediklerinde ChatGPT’nin bilgileri uydurmaya başladığını gördüler. Gözün yapısı ve tedavi metotlarını yapay zekâya detaylı olarak açıklayan araştırmacılar, sonrasında da ortalarında pek de fark olmayan iki prosedürü anlattı. Yeniden de ChatGPT 4, bir prosedürü öne çıkaracak kadar çok geçersiz bilgi üretti.

Yapay zekânın faydaları sık sık gündeme geliyor. Evet, birtakım süreçler için yapay zekâ epeyce yararlı olabiliyor. İş bilime ya da akademik çalışmalara geldiğinde yapay zekânın gerçek olmayan şeyleri gerçek üzere yazması önemli bir sorun ortaya çıkarıyor. Öte yandan buradaki tek sorun yapay zekânın olmayan bilgileri uydurması değil.

Yapay zekâya bir şiir yazdırırsanız ya da bir mevzuyu açıklatırsanız, intihal tespit programları size bu kısımları gösterebiliyor. Ya da makalenin yanlışlı kısmının düzeltilmesini sağlayabiliyor. İş sahte bilgilere geldiğinde, bu datalar denetim edilmezlerse literatüre geçebiliyorlar. Bu durumda gelecekteki çalışmalar da bu yanılgılı bilgilerden eklenebiliyor. Üstelik bu çalışmalar yanlışsız kabul edilirse, yanlışlı ve hatta ölümcül problemlere neden olabiliyor.

Araştırma, JAMA Ophitalmology‘de yayımlandı.

Kaynak; https://www.webtekno.com/chatgpt-inanilmaz-inandirici-sahte-tibb-raporlar-yaziyor-h138928.html